L’analyse de risque est souvent perçue comme un exercice

documentaire périphérique, destiné à alimenter des registres projet rarement

relus après les premiers comités de pilotage.

Dans les programmes critiques, cette vision est profondément

insuffisante.

Un système complexe ne dérive jamais brutalement. Il dérive

progressivement, au travers d’une accumulation de fragilités rarement

anticipées : dépendances invisibles, choix techniques devenus obsolètes, dette

organisationnelle, dégradation de la donnée, perte de compétences, contraintes

budgétaires, ou encore décalage progressif entre la plateforme et la réalité

métier.

La maîtrise technique seule ne permet pas d’éviter ces

dérives.

Car un programme Data, IA ou SaaS n’évolue jamais dans un

environnement figé. Il évolue dans un écosystème mouvant où les risques

eux-mêmes deviennent dynamiques.

Un choix technologique considéré comme pertinent aujourd’hui

peut devenir une faiblesse stratégique demain. Une stack peut perdre son

écosystème, voir son éditeur racheté, entrer en obsolescence ou devenir

incapable d’absorber de nouveaux besoins de scalabilité. Une dépendance externe

peut remettre en cause l’autonomie même de la plateforme.

L’analyse de risque devient alors un processus vivant,

continuellement réévalué au regard des transformations du contexte.

C’est précisément cette lecture évolutive qui justifie la

nécessité d’architectures modulaires et résilientes.

Car anticiper le risque ne consiste pas uniquement à éviter

une défaillance. Cela consiste aussi à préserver la capacité du système à

évoluer lorsque son environnement change.

L’analyse de risque devient ainsi un outil d’aide à la

conception autant qu’un outil de gouvernance.

Elle permet d’éclairer très tôt les arbitrages structurants

afin d’éviter que des décisions prises trop rapidement ne compromettent

durablement la viabilité du programme.

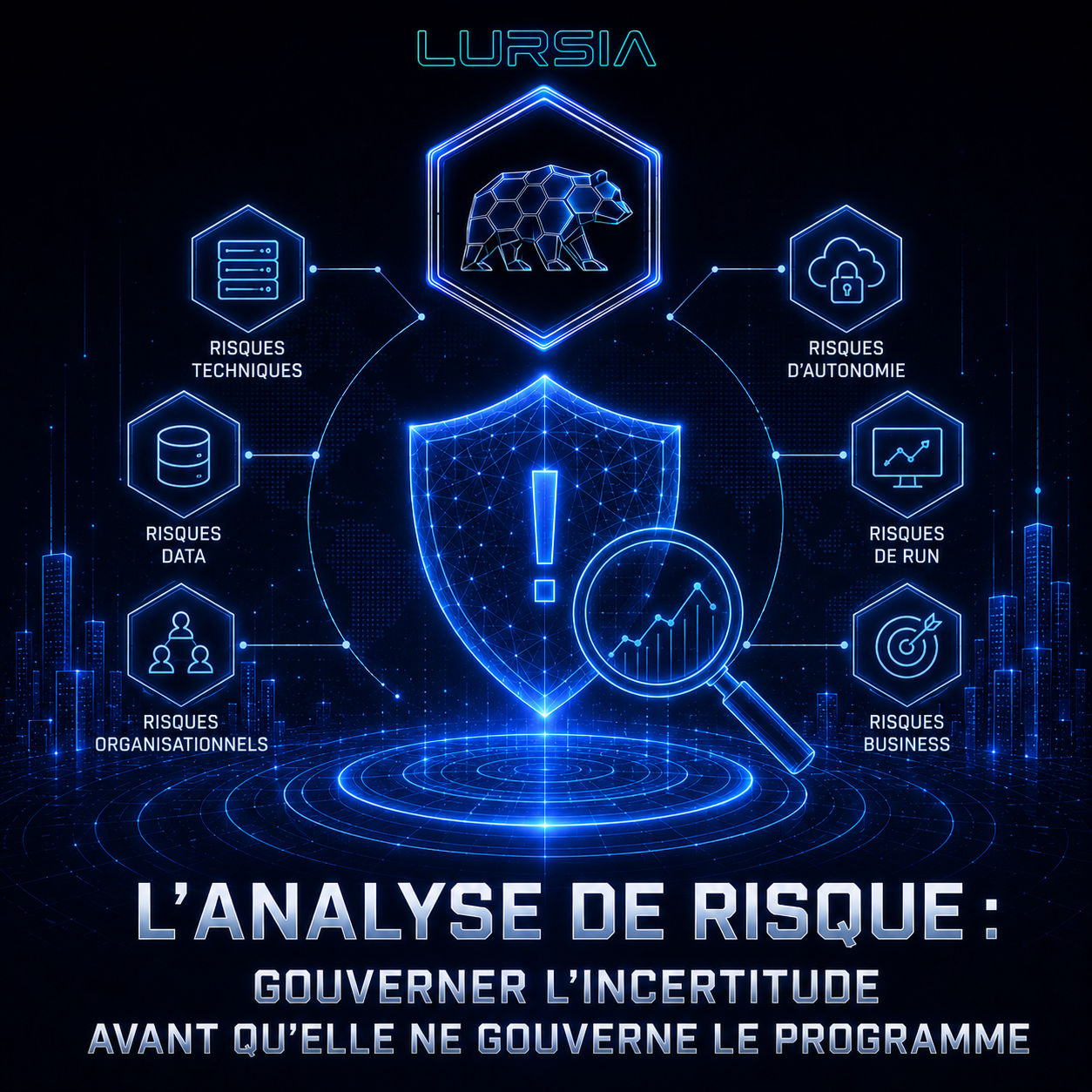

Sur l’axe technique, plusieurs typologies de risques

apparaissent systématiquement dans les programmes critiques.

La question de la scalabilité devient centrale dès

lors qu’une solution doit absorber des volumes croissants ou des usages

intensifs. Certains moteurs fonctionnent parfaitement dans des environnements

limités avant de révéler brutalement leurs limites en production.

La performance n’est d’ailleurs pas uniquement une

problématique algorithmique. Une architecture techniquement élégante mais

incapable de produire une expérience utilisateur fluide devient rapidement un

facteur de rejet opérationnel.

Des sujets parfois considérés comme secondaires —

authentification, onboarding, UX, gestion des sessions, latence de recherche —

deviennent alors des points critiques de perception utilisateur.

La résilience opérationnelle constitue un autre axe majeur.

La capacité à reconstruire un système après incident, à

maintenir une continuité d’activité ou à restaurer rapidement un environnement

dégradé impose très tôt la mise en place d’un véritable Disaster Recovery

Plan.

Cette problématique est souvent sous-estimée dans les phases

amont, alors qu’elle conditionne directement la robustesse réelle d’une

plateforme.

L’environnement technique lui-même constitue également un

facteur de risque permanent.

Les développeurs découvrent régulièrement qu’un système “qui

fonctionnait parfaitement il y a quelques mois” devient progressivement

instable non pas parce que son code a changé, mais parce que tout ce qui

l’entoure évolue : dépendances, runtimes, bibliothèques, APIs, systèmes

d’exploitation, navigateurs ou services tiers.

Le logiciel vieillit mécaniquement avec son environnement.

L’analyse doit également révéler les risques liés aux choix

de stack : maturité insuffisante de certaines technologies, difficulté à

recruter des profils compétents, dépendance excessive à des éditeurs ou

partenaires, ou encore risque de verrouillage technologique limitant la

flexibilité future.

Dans les programmes Data et IA, l’axe data devient

évidemment central.

Une donnée incomplète, incohérente ou insuffisamment

maîtrisée dégrade directement la qualité des résultats produits. Or dans un

système IA, une dégradation de la qualité des résultats produit immédiatement

une dégradation de la confiance utilisateur.

La donnée devient donc un risque systémique.

Ce risque dépasse largement la simple problématique

technique. Il touche directement l’adoption métier, la crédibilité du système

et parfois même la légitimité du programme dans son ensemble.

L’analyse doit également intégrer les dépendances

structurelles de la plateforme.

De nombreuses architectures restent fortement exposées à des

systèmes legacy ou à des chaînes de production historiques. Le risque ne réside

alors pas uniquement dans la dette technique, mais dans la perte d’autonomie

stratégique du programme.

La capacité à transformer un système dépend directement de

sa capacité à limiter ses dépendances critiques.

L’axe organisationnel constitue enfin l’un des risques les

plus sous-estimés.

Perte de compétences clés, turnover, dépendance à certaines

expertises rares, désalignement entre équipes Build, Run, architecture et

métiers : ces éléments ralentissent souvent davantage un programme qu’un

problème purement technique.

Une organisation désynchronisée produit mécaniquement de la

dette opérationnelle.

Enfin, l’analyse de risque doit mettre en évidence les

fragilités liées au pilotage produit lui-même.

Une mauvaise priorisation fonctionnelle peut casser la

vélocité des squads, multiplier le rework, désaligner les développements des

besoins utilisateurs réels et provoquer une perte progressive de cohérence

stratégique.

Le principal enseignement est donc le suivant :

la gestion des risques ne doit pas être un simple

exercice de conformité projet.

Elle doit devenir un véritable outil de gouvernance

stratégique capable d’éclairer les arbitrages technologiques,

organisationnels, data, sécurité, staffing et business tout au long de la vie

du programme.

Car dans les systèmes critiques, la robustesse ne provient

jamais uniquement de la technologie.

Elle provient de la capacité à anticiper les fragilités

avant qu’elles ne deviennent structurelles.

Pour aller plus loin:

L’ouvrage “Thinking in Systems” de Donella Meadows

constitue une référence majeure pour comprendre comment les systèmes complexes

dérivent progressivement sous l’effet d’interactions invisibles et de

dépendances structurelles.

Le livre “Accelerate” de Nicole Forsgren, Jez Humble

et Gene Kim montre comment la maîtrise des risques opérationnels,

organisationnels et techniques influence directement la performance et la

résilience des organisations technologiques.

Enfin, les travaux du National Institute of Standards and

Technology autour du NIST Risk Management Framework (RMF) offrent une

approche structurée particulièrement pertinente pour penser la gestion des

risques dans les systèmes critiques modernes.